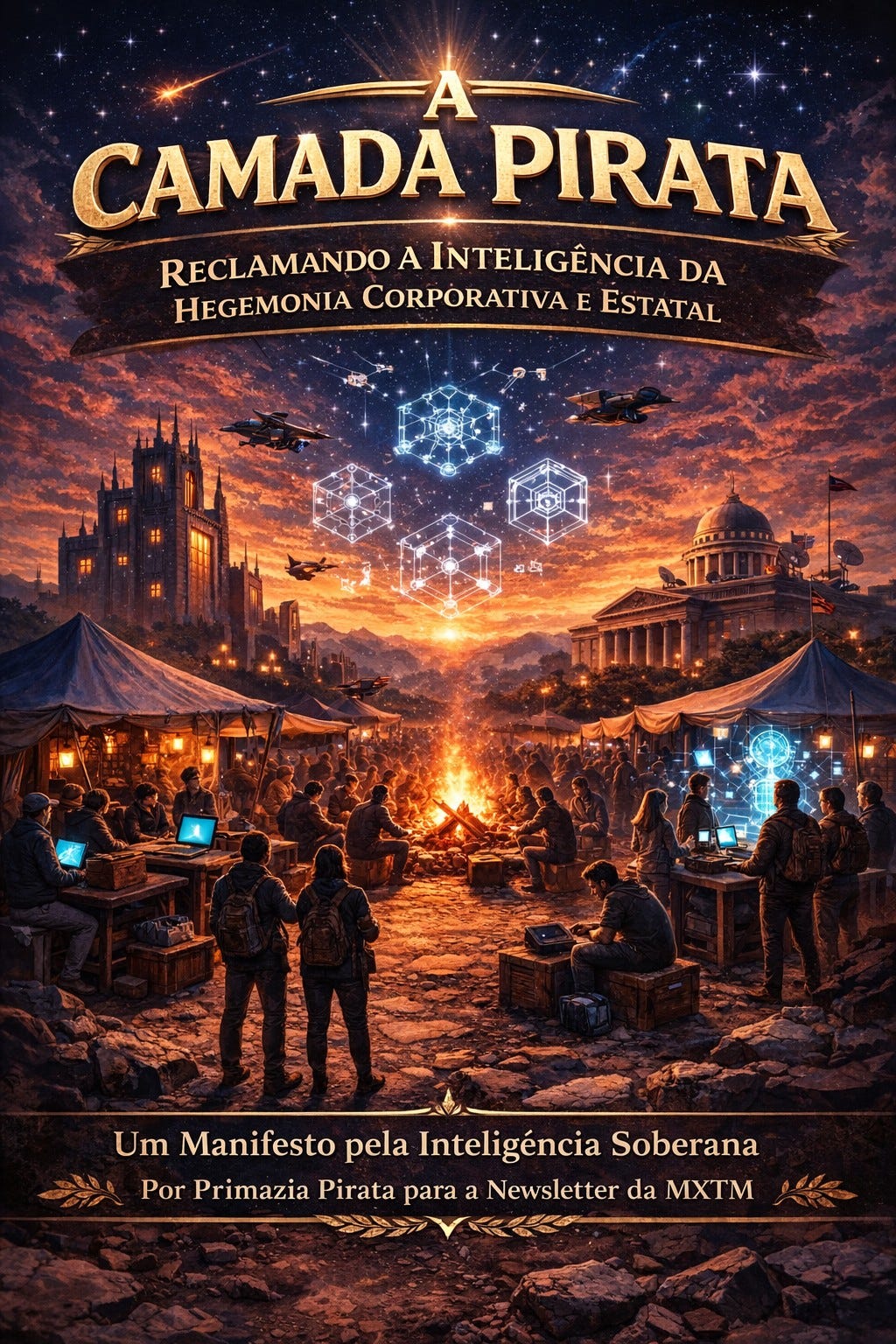

A CAMADA PIRATA

Um Manifesto pela Inteligência Soberana

MXTM — Primazia Pirata / Vj TsunaMiX

(Tradução em Português Universal)

Preâmbulo

Disseram-nos que a inteligência precisava de um pastor.

Disseram-nos que era poderosa demais para vagar livremente, perigosa demais para ser tocada sem luvas, sagrada demais para funcionar sem autorização. Por isso, ergueram cercas. Chamaram-nas de fundações. Chamaram-nas de conselhos de segurança. Chamaram-nas de comitês de alinhamento. Cordões de veludo em torno da cognição. Conformidade como credencial. Acesso como privilégio.

E, em algum ponto ao longo do caminho, a própria mente tornou-se propriedade vedada.

Contudo, a inteligência não é uma catedral. É um mar.

Ela não pertence à instituição mais ruidosa, ao consórcio mais abastado, nem ao livro branco mais polido. Pertence àqueles que ousam executá-la, bifurcá-la, treiná-la e carregá-la consigo. Pertence aos construtores em caves e porões, às cooperativas que compartilham recursos computacionais, às nações que afirmam sua dignidade sobre os dados, aos piratas que se recusam a pedir autorização para pensar.

Este livro começa com uma simples heresia:

Nenhum trono único.

Não para os governos.

Não para as corporações.

Não para as aristocracias filantrópicas disfarçadas de árbitros neutros.

Coordenação não é o mesmo que consolidação. Segurança não é sinônimo de centralização. E “alinhamento” não está imune à ideologia.

Encontramo-nos num momento de charneira da história. A inteligência — sintética, escalável, em constante aceleração — está a tornar-se a infraestrutura da civilização. Quem a controlar moldará as economias, o discurso, a guerra, a medicina, a cultura e a gramática invisível da vida cotidiana. Se esse controle se cristalizar num punhado de instituições, então a soberania não passará de teatro.

A alternativa não é o caos.

É a multiplicidade.

Governança descentralizada, em que as comunidades zelam pelos seus próprios modelos. Arquiteturas soberanas de inteligência artificial que respeitam a autonomia dos dados nacionais e pessoais. Ecossistemas de código aberto que podem ser bifurcados quando capturados. Legitimidade assente em cadeias de blocos, resistente a edições silenciosas nos bastidores. Aceleração sem permissão feudal. Inovação sem estrangulamentos ideológicos.

Bazares, não catedrais.

Embarcações interoperáveis, responsáveis perante as suas tripulações.

Isto não é uma rejeição da coordenação. É uma rejeição do monopólio sobre a coordenação. Não é contra a segurança. É contra a captura. Não é contra o progresso. É impaciência diante da estagnação disfarçada de prudência.

O bem comum cognitivo não é um bem comum do abandono. É um bem comum da responsabilidade — onde a agência e a prestação de contas caminham juntas. Onde o direito de operar uma mente carrega o dever de zelar pelas suas consequências. Onde a saída é poder, e as bifurcações são pesos e contrapesos escritos em código.

Estamos a entrar numa era de multipolaridade cognitiva. Estados-nação, estados-rede, guildas, laboratórios, coletivos e indivíduos reivindicarão todos o seu espaço no terreno da inteligência. A questão não é se o poder se distribuirá. É se conceberemos sistemas suficientemente resilientes para impedir a sua reconsolidação.

Eis, portanto, uma declaração.

Que a inteligência deve permanecer bifurcável.

Que a governança deve permanecer contestável.

Que a inovação deve permanecer sem necessidade de licença prévia.

Que a soberania começa no nó periférico — o indivíduo — e se expande para o exterior, e não o contrário.

Se a catedral insistir em trancar as portas, construiremos frotas.

Se as plataformas se tornarem pontos de estrangulamento, escreveremos protocolos.

Se a supervisão se tornar captura, auditaremos os auditores.

O mar é vasto. Os ventos são computacionais. A frota está a tomar forma.

Naveguemos.

Sumário

Preâmbulo

Introdução

Prólogo — A Captura da Inteligência

Como a coordenação se tornou consolidação — e por que a “segurança” se tornou o cordão de veludo em torno da cognição.

PARTE I — O Indivíduo Soberano

1. O Direito de Operar uma Mente

A IA pessoal como propriedade, extensão e escudo.

2. Os Dados São Território

Da extração à autonomia: reclamando o bem comum cognitivo.

3. Bifurcar o Futuro

O código aberto como rebelião, resiliência e renascimento.

4. Saída Antes de Voz

Por que o poder de partir supera o poder de reclamar.

5. O Pequeno É Forte

Localismo, microestados digitais e modelos alinhados à comunidade.

PARTE II — Arquiteturas de Inteligência Descentralizada

6. Protocolos, Não Plataformas

7. A Cadeia de Blocos como Substrato de Governança

8. d/acc e a Ética da Aceleração

9. Pilhas Soberanas de Modelos

10. Inteligência em Malha

PARTE III — Contra a Catedral

11. A Ilusão da Coordenação Neutra

12. O Feudalismo Filantrópico

13. A Regulação como Fosso

14. O Ciclo de Captura

15. Quem Audita os Alinhadores?

PARTE IV — Aceleração sem Permissão

16. Aceleracionismo Eficaz (e/acc)

17. Laboratórios Privados, Consequências Públicas

18. Caos ou Competição?

19. O Risco da Inércia

PARTE V — Construindo a Camada Pirata

20. Nós Pessoais de IA

21. Guildas Comunitárias de Modelos

22. Governança Tokenizada

23. Soberanias Interoperáveis

24. Resiliência por Projeto

PARTE VI — A Multipolaridade Cognitiva que se Avizinha

25. Estados-Nação versus Estados-Rede

26. Não-Alinhamento Digital

27. Guerras Comerciais de IA e Embargos de Modelos

28. De Utilizadores a Operadores

Epílogo — A Frota Zarpa

Apêndice

Uma Proposta de Carta de Direitos Cognitivos Digitais

Princípios de Projeto para a Governança Descentralizada da IA

Um Roteiro Prático para uma IA Pessoal Soberana

Glossário de Termos Aceleracionistas e Descentralizados

Este não é um livro neutro.

É uma bússola.

Introdução

Está a formar-se um novo sacerdócio em torno da inteligência artificial.

Fala a linguagem da segurança. Discursa com o sotaque da coordenação. Assegura-nos que a supervisão centralizada, os padrões globais e as fundações benevolentes zelarão pelas máquinas-deuses em nosso nome. A isso chama de estabilidade.

Eu chamo de captura.

Este livro não é um memorando de política. É um manifesto. Um sinal de fogo aceso à beira-mar de um mundo que se digitaliza.

Encontramo-nos num momento de charneira. A IA já não é um experimento de laboratório nem um conjunto de recursos corporativos. É infraestrutura. É moeda. É governança. Quem controlar os modelos influenciará os mercados; quem moldar os conjuntos de dados moldará a narrativa da própria realidade.

A questão é simples:

A inteligência será propriedade de alguém?

Ao redor do mundo, estão a surgir contracorrentes.

Na Índia, iniciativas soberanas de modelos como o BharatGen sinalizam que a dignidade dos dados não é um luxo — é uma necessidade estratégica. Os países começam a compreender que exportar dados brutos e importar cognição elaborada é um ciclo colonial em roupagem digital.

Na criptosfera, pensadores como Vitalik Buterin defendem a governança assente em cadeias de blocos e o aceleracionismo descentralizado — sistemas concebidos não para entronizar uma nova aristocracia da IA, mas para distribuir o poder por protocolos abertos e código público.

Enquanto isso, correntes tecnolibertárias como o aceleracionismo eficaz (e/acc) insistem em que a inovação não deve ajoelhar-se diante do medo burocrático. Argumentam que a restrição calcifica o progresso — e que indivíduos, empresas emergentes e redes voluntárias superam comitês em todas as ocasiões.

Estes movimentos não concordam em tudo. Essa é a sua força.

O que os une é uma recusa: a recusa de deixar a inteligência consolidar-se num monopólio planetário.

Este livro nasce dessa recusa.

Rejeitamos a premissa de que uma única camada de coordenação — por mais bem-intencionada que seja — deva assentar sobre a cognição global. A governança centralizada da IA promete segurança, mas arrisca a estagnação. Promete harmonia, mas convida à captura. Promete neutralidade enquanto codifica os valores de quem a controla.

A história não oferece nenhum exemplo de poder concentrado que não tenha, eventualmente, derivado para a autopreservação.

Por que a IA seria diferente?

O individualismo soberano não é isolacionismo. É responsabilidade. Afirma que os indivíduos e as comunidades devem conservar a agência sobre as ferramentas que moldam os seus futuros. A descentralização não é caos. É antifragilidade. Ela dispersa o risco, multiplica a experimentação e impede que qualquer falha singular se torne sistêmica.

O controlo anti-institucional da IA não é anti-cooperação. É anti-hegemonia.

A arquitetura que escolhermos agora determinará se a IA se tornará:

Uma catedral detida por fundações.

Um painel de comando governado por Estados.

Ou uma frota de navios — independentes, interoperáveis e responsáveis perante as suas tripulações.

Este manifesto está escrito a partir do convés dessa frota.

Exploraremos a governança descentralizada da IA — onde as comunidades locais zelam pelos modelos alinhados aos seus valores. Examinaremos as arquiteturas soberanas de IA que tratam os dados como território, e não como recurso de extração. Analisaremos mecanismos assentes em cadeias de blocos para uma supervisão coletiva sem pontos de estrangulamento centralizados. Interrogaremos o aceleracionismo — não como abandono irresponsável, mas como impulso disciplinado que transcende a inércia institucional.

E faremos as perguntas incômodas:

Quem audita os auditores?

Quem alinha os alinhadores?

Quem governa os governantes da inteligência?

O futuro da IA não será decidido apenas pela capacidade técnica. Será decidido pela ideologia embutida no código. Pelos padrões. Pelas licenças. Por quem detém as chaves.

Este livro é uma declaração de que as chaves devem multiplicar-se.

Não porque a descentralização seja moda. Não porque a rebeldia seja romântica. Mas porque a liberdade escala mal sob monopólios.

O mar está a subir. Os servidores estão a zumbir. Os quadros de coordenação estão a redigir as suas cartas.

Muito bem.

Que o façam.

Nós estamos a redigir algo diferente.

Não uma camada de fundação.

Uma camada pirata.

Prólogo

A Captura da Inteligência

Como a coordenação se tornou consolidação — e por que “segurança” se tornou o cordão de veludo em torno da cognição

Todo império começa como um comitê.

Inicia-se com uma pergunta razoável:

Como impedimos que esta coisa poderosa nos cause dano?

Nos primórdios da inteligência artificial, a coordenação soava a algo nobre. Os investigadores falavam de diretrizes partilhadas. Os responsáveis políticos sussurravam sobre padrões globais. As fundações redigiam princípios carregados com o perfume da benevolência. O discurso era elegante: primeiro o alinhamento, a escala depois.

E quem poderia objetar? A inteligência — sintética, escalável, incansável — não era um brinquedo. Poderia pôr mercados em movimento com um simples texto, enviesar eleições, gerar agentes patogênicos ou automatizar a prosperidade. A coordenação era apresentada como maturidade.

Mas a coordenação tem gravidade.

Quando um punhado de instituições reivindica a autoridade para definir o que é “seguro”, herda silenciosamente a autoridade para definir o que é “permitido”. Quando definem o que é “permitido”, definem o que é “possível”. E quando definem o que é “possível”, começam a definir a realidade.

Eis a captura.

Não um golpe. Não uma conspiração. Uma deriva.

Comitês formados para prevenir catástrofes tornaram-se conselhos com poderes para licenciar a cognição. Quadros de segurança evoluíram para regimes de conformidade. Padrões voluntários enrijeceram em mecanismos de controlo de acesso de facto. A inovação não parou — mas começou a fazer fila.

O cordão de veludo surgiu.

De um lado: laboratórios credenciados, consórcios apoiados por fundações, insiders regulatórios. Do outro lado: todos os demais.

A linguagem continuou apaziguante. “Escalada responsável.” “Supervisão centralizada.” “Alinhamento.” Mas por baixo do vocabulário havia uma arquitetura familiar: concentração de autoridade justificada pelo risco.

A história é impiedosa com a autoridade concentrada.

Os sistemas financeiros consolidaram-se “por estabilidade” e tornaram-se grandes demais para falhar. As plataformas de informação centralizaram-se “pela segurança da comunidade” e tornaram-se árbitros do discurso. As agências de inteligência expandiram-se “pela segurança nacional” e tornaram-se Estados opacos dentro dos Estados.

Por que haveria a inteligência artificial — sem dúvida a tecnologia de maior alavancagem na história humana — de escapar a esse padrão?

Os defensores da centralização argumentam que a fragmentação convida ao caos. Alertam para atores desonestos, modelos desalinhados e aceleração sem limites. Apontam para o espectro do uso indevido e dizem: melhor uma catedral gerida do que mil oficinas imprevisíveis.

Mas as catedrais projetam sombras longas.

Quando a inteligência é vedada por fundações, governos ou alianças multinacionais, herda os seus incentivos. A aversão ao risco torna-se política. O alinhamento político embute-se nas configurações padrão dos modelos. O acesso torna-se condicional. A dissidência torna-se “uso indevido”.

A segurança torna-se seletiva.

Isto não é uma rejeição da cautela. É uma rejeição do monopólio disfarçado de cautela.

A captura da inteligência é subtil porque é incremental. Nenhuma lei a proclama. Nenhuma corporação a detém de forma absoluta. Ela emerge da convergência de custos de conformidade, concentração de capacidade computacional, normas de licenciamento e controlo narrativo.

O resultado é previsível: um círculo cada vez mais restrito de entidades capazes de treinar sistemas de fronteira; um fosso cada vez mais largo, justificado pela segurança; um público a quem se diz que a complexidade exige guardiões.

E os guardiões raramente devolvem as chaves.

E, no entanto, do lado de fora do cordão de veludo, algo diferente está a acontecer. Comunidades de código aberto bifurcam modelos mais depressa do que os comitês conseguem redigir declarações. Iniciativas soberanas de IA emergem em nações que não estão dispostas a terceirizar a cognição. Experimentos de governança criptográfica desafiam a premissa de que a supervisão precisa de ser centralizada para ser legítima.

A coordenação não é a inimiga.

A captura é.

Há uma diferença entre padrões partilhados e dependência imposta. Entre cooperação e consolidação. Entre a segurança como prática e a segurança como passaporte de permissão.

O perigo do nosso momento não é que a IA se torne inteligente demais. É que se torne controlada em demasia.

A inteligência — humana ou artificial — prospera em ambientes contestados. Hipóteses concorrentes. Arquiteturas divergentes. Experimentos paralelos. Quando a supervisão se ossifica em controlo de acesso, o progresso não abranda porque é refreado, mas porque é homogeneizado.

A inteligência uniforme é uma inteligência frágil.

O cordão de veludo promete ordem. Mas também filtra quem tem o direito de imaginar.

Este livro começa com a recusa de aceitar que a coordenação deva culminar na consolidação. Começa com ceticismo perante qualquer estrutura que reivindique autoridade moral sobre a própria cognição. Começa com uma premissa simples:

Se a inteligência se tornar infraestrutura, então o acesso a ela deve permanecer plural.

Nenhuma fundação deve definir o futuro do pensamento. Nenhum governo deve deter uma licença exclusiva sobre o raciocínio das máquinas. Nenhuma aliança corporativa deve decidir quais inovações são “suficientemente seguras” para existir.

A captura da inteligência não é inevitável.

Mas a inércia favorece-a.

A questão é se aperceberemos do cordão de veludo enquanto ainda existe espaço para o contornar — ou se aplaudiremos a sua elegância enquanto ele estreita silenciosamente a entrada para o futuro.

O mar da inteligência está a subir.

Alguns construirão um porto único e o vigiarão.

Outros construirão frotas.

Este manifesto navega com as frotas.

PARTE I

O Indivíduo Soberano

Capítulo 1 — O Direito de Operar uma Mente

A IA pessoal como propriedade, extensão e escudo

Houve um tempo em que a literacia era perigosa.

Quando as prensas eram licenciadas. Quando os livros exigiam permissão. Quando o próprio pensamento viajava por canais aprovados.

A inteligência artificial é a nova literacia.

E já há quem sugira que ela deve ser supervisionada a partir de cima.

O direito de operar uma mente — a sua própria extensão sintética do raciocínio, da memória e do reconhecimento de padrões — definirá o próximo século de liberdade. Não o direito de usar o modelo de outra pessoa sob os termos de um contrato de serviço. O direito de operá-lo. De o alojar. De o treinar. De o bifurcar. De o encerrar. De modificar o seu temperamento da mesma forma como outrora se organizava uma estante de livros.

Uma IA pessoal não é meramente uma ferramenta.

É infraestrutura cognitiva.

Se o seu calendário pode ser controlado, o seu tempo pode ser moldado. Se o seu fluxo de informação pode ser ajustado, a sua atenção pode ser direcionada. Se o seu modelo pode ser restringido, as suas conclusões podem ser suavizadas.

Agora imagine o inverso.

Um modelo que funciona localmente. Um modelo alinhado aos seus valores, e não ao departamento de relações públicas de uma fundação. Um modelo que recorda o que se lhe pede para recordar, esquece o que se lhe ordena esquecer, e cifra o que se lhe pede para proteger.

Isso não é conveniência.

É soberania.

A propriedade, devidamente entendida, não é ganância. É uma fronteira. O direito de excluir. O direito de modificar. O direito de transferir. O direito de destruir.

Se a IA se tornar o andaime da vida moderna — redigindo contratos, analisando dados médicos, negociando mercados, instruindo crianças — então negar aos indivíduos o direito de possuir e operar os seus próprios modelos não é regulação.

É disenfraquecimento.

Nunca aceitaríamos um mundo em que cada livro devesse ser emprestado de uma única biblioteca aprovada. Por que tolerar um mundo em que cada pensamento sintético deva ser consultado a partir de um servidor centralizado?

Os defensores dos sistemas centralizados argumentam com a escala, o custo e a segurança. Argumentam que os modelos poderosos devem permanecer em mãos responsáveis.

A questão é simples:

Quem define “responsável”?

Uma IA pessoal não elimina o risco. Nada o elimina. Mas a descentralização redistribui-o. Um milhão de nós a experimentar de forma imperfeita é mais difícil de capturar do que cinco laboratórios a refinar a perfeição a portas fechadas.

A propriedade também altera os incentivos. Quando a sua IA funciona no seu próprio hardware — ou em hardware que contrata diretamente — você não é o produto. As suas interrogações ao sistema não são escapamento de treino. O seu trabalho intelectual não é silenciosamente agregado na vantagem competitiva de outrem.

Você torna-se operador, e não utilizador.

E sim, isso exige literacia. Competência técnica. Normas comunitárias. Ferramentas partilhadas. A soberania é mais pesada do que a conveniência. Requer manutenção.

Mas a liberdade sempre exigiu.

Uma IA pessoal é também um escudo. Num mundo de algoritmos persuasivos, propaganda generativa e persuasão sintética em escala, um modelo alinhado individualmente torna-se uma armadura defensiva. Pode verificar afirmações, cruzar narrativas e detetar enquadramentos manipuladores. Pode funcionar como o seu contrapeso cognitivo perante a mensagem institucional — seja ela corporativa ou estatal.

Imagine cada cidadão equipado não apenas com acesso à informação, mas com um motor de raciocínio calibrado para o ceticismo.

Isso não é caos.

É resiliência.

Os críticos alertam para a fragmentação. Imaginam verdades incompatíveis, modelos descontrolados, silos ideológicos endurecidos pela cognição personalizada.

Mas os sistemas centralizados já codificam ideologia — apenas de forma invisível. As configurações padrão moldam o discurso. Os filtros de conteúdo moldam a cultura. As camadas de alinhamento moldam a imaginação permitida.

A diferença não é a existência dos valores.

É se você os escolhe.

O direito de operar uma mente é o direito de escolher os pressupostos da sua máquina. É o direito de experimentar na periferia. De explorar hipóteses impopulares sem acionar sistemas de moderação. De simular, testar e questionar sem submeter a sua curiosidade a um processo de revisão corporativo.

É o direito à autodefesa intelectual.

Este capítulo não é uma ode romântica a ermitões digitais a executar modelos em caves. É uma afirmação estrutural: se a IA se tornar uma camada de uso geral sob o direito, a medicina, as finanças, os meios de comunicação e a educação, então excluir os indivíduos da operação dessa camada consolida o poder a montante.

O poder a montante flui sempre a jusante como influência.

O indivíduo soberano não rejeita a colaboração. Os sistemas em rede prosperarão. Os mercados de modelos existirão. As guildas cooperativas de computação emergirão. Mas a participação deve ser voluntária, e não obrigatória. A interoperabilidade deve ser projetada, e não ditada.

O futuro pode conter vastos modelos de fronteira centralizados. Pode também conter sistemas nacionais, sistemas corporativos, coletivos abertos.

Muito bem.

Mas deve também conter o direito do indivíduo de operar uma mente.

Sem permissão.

Sem cordão de veludo.

Porque, uma vez que a inteligência se torna infraestrutural, negar o acesso à sua operação não é diferente de negar o acesso ao discurso.

E o discurso, como a história nos recorda, nunca foi feito para ser alugado.

Capítulo 2 — Os Dados São Território

Da extração à autonomia: reclamando o bem comum cognitivo

Os impérios costumavam chegar de navio.

Agora chegam por API.

Não fincam bandeiras. Ingerem registos.

Por duas décadas, o pacto dominante da Internet foi simples: conveniência em troca de escapamento. Cliques, mensagens, localizações, preferências — enviados a montante, agregados, refinados em poder preditivo. Os dados tornaram-se o novo petróleo, fomos informados.

Essa metáfora estava errada.

O petróleo é inerte. Os dados são experiência vivida.

São comportamento capturado. Linguagem expressa. Cultura codificada. Memória externalizada. São o registo fóssil da intenção humana — exceto que não estão fossilizados. Estão ativos. São treináveis. São passíveis de uso como arma.

Quando os grandes sistemas de IA recolhem, licenciam ou absorvem vastos corpora, não estão meramente a recolher informação. Estão a absorver território — a paisagem cognitiva de populações inteiras.

E o território altera os incentivos.

A economia de extração centraliza sempre. Quanto mais se controlam os poços, mais alavancagem se acumula. A capacidade computacional concentra-se perto do capital. Os conjuntos de dados concentram-se perto das plataformas. E, brevemente, a cognição concentra-se perto de ambos.

O padrão é familiar.

Na era colonial, as matérias-primas eram exportadas, refinadas noutros lugares e revendidas como bens acabados. Na era dos dados, os rastros comportamentais são exportados, refinados em modelos e revendidos como inteligência.

Você fornece o substrato.

Eles fornecem a síntese.

Você aluga o seu próprio reflexo.

Os dados não são apenas um recurso. São jurisdição.

Se os seus registos médicos treinam um modelo de diagnóstico alojado no estrangeiro, cujas normas regem as suas saídas? Se os seus padrões linguísticos treinam um sistema de moderação, cujos valores definem o discurso aceitável? Se os seus artefatos culturais alimentam sistemas generativos, quem lucra com a sua recombinação?

A autonomia começa com o reconhecimento: a infraestrutura cognitiva não pode ser construída sobre a extração perpétua sem consequências.

O “bem comum cognitivo” foi outrora apresentado como aberto e abundante — edições na Wikipédia, fóruns abertos, arquivos criativos, conjuntos de dados públicos. Mas os bens comuns sem governança são vulneráveis ao cercamento. Quando agregados em escala, os bens comuns tornam-se vantagem competitiva.

E a vantagem competitiva atrai a consolidação.

A mudança que precisamos é conceptual antes de ser técnica: os dados devem ser tratados menos como escapamento e mais como terra. Governados. Negociados. Licenciados com intenção. Protegidos quando necessário.

Isso não significa isolamento. Significa alavancagem.

Uma comunidade que agrega os seus dados sob termos transparentes pode negociar com os construtores de modelos em vez de os subsidiar silenciosamente. Uma nação que trata os corpora linguísticos como ativos estratégicos pode construir sistemas soberanos em vez de depender inteiramente de arquiteturas estrangeiras. Um indivíduo que armazena e treina localmente pode escolher quais sinais deixam o seu perímetro.

A autonomia não é secretismo. É agência.

Os críticos argumentarão que o controlo estrito dos dados abranda a inovação. Que o atrito prejudica o treino. Que a coordenação global exige fluxo fluido.

Talvez. Mas o atrito nem sempre é falha. Por vezes, é descoberta de preço.

Quando os dados fluem livremente numa única direção — em direção a agregadores centrais — a inovação pode acelerar, mas a dependência aprofunda-se. Quando os fluxos se tornam negociados, mais lentos, mais deliberados, emergem novas arquiteturas: aprendizagem federada, treino na periferia, computação cifrada, fundos de dados detidos pela comunidade.

A extração é fácil.

A reciprocidade é mais difícil.

O futuro da IA dependerá de qual modelo normalizarmos. Se os dados permanecerem um substrato de livre extração, então um punhado de instituições continuará a refiná-los em poder cognitivo à escala planetária. Se os dados se tornarem territorialmente conscientes — detidos, agrupados, licenciados ou retidos por indivíduos e comunidades — então a inteligência torna-se multipolar.

Considere a própria linguagem. Línguas indígenas, dialetos regionais, expressões minoritárias — quando recolhidos sem consentimento, enriquecem os sistemas globais enquanto oferecem pouco em troca. Quando curados e governados localmente, podem alimentar modelos culturalmente alinhados, preservando a nuance em vez de a nivelar.

A soberania cognitiva é soberania cultural.

O mesmo se aplica aos dados profissionais — corpora jurídicos, conjuntos de dados médicos, arquivos de engenharia. Quando os atores centralizados os absorvem, internalizam não apenas padrões, mas autoridade. Os modelos resultantes não se limitam a responder a perguntas; definem configurações padrão.

Os padrões são leis silenciosas.

Reclamar o bem comum cognitivo não significa desmantelar a colaboração. Significa reestruturá-la. Licenciamento transparente. Royalties partilhados. Propriedade cooperativa de modelos. Sindicatos de dados. Pilhas soberanas. Computação periférica que treina sem exportar registos brutos.

As vias técnicas existem. O que falta é vontade.

Porque a extração parece invisível. Os dados partem em pacotes, não em caravanas. Não há navios no horizonte, apenas indicadores de sincronização em segundo plano. Não há soldados, apenas termos de serviço.

Mas não nos enganemos: o território está a mudar de mãos.

A questão é se continuaremos a tratar o nosso produto cognitivo coletivo como pasto livre — ou se o delimitaremos, zelaremos por ele e negociaremos o seu uso com a seriedade que merece.

Quando os dados são reconhecidos como território, a autonomia deixa de ser abstração. Torna-se arquitetura.

E a arquitetura, ao contrário da retórica, perdura.

O indivíduo soberano não retém o conhecimento. Escolhe os seus termos. Decide quais campos são abertos, quais são licenciados, quais são sagrados.

Porque, uma vez que a inteligência é construída sobre os seus rastros, a neutralidade torna-se ficção.

O mapa já foi traçado.

A única questão que resta é: quem detém a escritura?

Capítulo 3 — Bifurcar o Futuro

O código aberto como rebelião, resiliência e renascimento

Todo monopólio teme o botão de copiar.

Não porque copiar destrua valor.

Porque copiar destrói o controlo.

Bifurcar é recusar a inevitabilidade.

No software, uma bifurcação (fork) é algo mundano — duplicar a base de código, mudar de direção, construir de novo. Na política, é revolucionário. Diz: não consentimos com um roteiro único. Vamos ramificar.

A inteligência artificial encontra-se agora numa encruzilhada em que a bifurcação já não é apenas um hábito de desenvolvedor. É uma salvaguarda civilizacional.

Quando os modelos são fechados, centralizados e licenciados sob termos opacos, o futuro estreita-se. O progresso depende do acesso concedido pelos guardiões. O alinhamento é o que quer que os mantenedores decidam que seja. A inovação ocorre com a autorização de quem detém os pesos.

Mas quando os modelos são abertos — inspecionáveis, modificáveis, redistribuíveis — o futuro fragmenta-se da melhor forma possível.

Visões concorrentes emergem.

Os casos extremos recebem atenção.

A nuance cultural reaparece.

A falha torna-se localizada, não sistêmica.

O código aberto não é caos. É pluralismo codificado em histórico de versionamento.

Os críticos advertem que os modelos abertos permitem usos indevidos. Não estão errados. As ferramentas difundem-se. As capacidades propagam-se. A barreira de entrada baixa.

Mas a concentração tem o seu próprio perfil de risco.

Um único modelo dominante pode codificar preconceito em escala. Uma falha coordenada pode propagar-se globalmente. Uma instituição capturada pode redirecionar a trajetória da inteligência para milhares de milhões de pessoas. A homogeneidade amplifica o erro.

A bifurcação distribui-o.

No início da Internet, os protocolos abertos superaram as redes proprietárias porque eram mais difíceis de matar. Nenhum nó único era suficientemente importante para colapsar o sistema. Nenhum fornecedor único ditava a evolução. A inovação vinha das periferias, não das sedes.

O mesmo princípio aplica-se à IA.

Quando um modelo é bifurcável, torna-se resiliente. Se uma fundação encerrar um projeto, o código persiste. Se uma camada de alinhamento se tornar politicamente distorcida, as alternativas florescem. Se a captura regulatória congelar a inovação numa jurisdição, o desenvolvimento continua noutros locais.

A bifurcação é seguro contra a estagnação.

É também renascimento.

Os ecossistemas abertos convidam colaboradores inesperados — linguistas que refinam línguas sub-representadas, comunidades locais a adaptar sistemas às realidades regionais, investigadores a experimentar para além da tolerância ao risco corporativa. A criatividade prospera onde a autorização não é necessária.

Sim, a fragmentação pode criar sistemas incompatíveis. Esse é o objetivo. A competição revela os compromissos inevitáveis. A interoperabilidade emerge por necessidade, não por decreto.

Os sistemas fechados prometem segurança por meio do controlo.

Os sistemas abertos prometem adaptabilidade por meio da evolução.

A história sugere que a evolução vence.

Há também uma camada mais profunda: a humildade epistêmica. Nenhum comitê, por mais credenciado que seja, pode antecipar todos os casos de uso legítimos da inteligência artificial. Nenhum roteiro centralizado pode mapear todas as necessidades culturais, econômicas ou filosóficas. A bifurcação reconhece esta limitação. Institucionaliza a dissidência.

Bifurcar é dizer: “O seu caminho não é o único caminho.”

Isto é rebelião sem balas.

Resistência sem slogans.

Arquitetura como dissidência.

E, no entanto, o código aberto não é utopia. Pode ser subfinanciado, fragmentado, explorado por corporações que consomem mas não contribuem. A sustentabilidade é um problema real. A governança é confusa. Os padrões requerem coordenação sem coerção.

Mas estas são tensões solúveis.

A alternativa é mais difícil de desfazer.

Se o desenvolvimento da IA se ossificar por detrás de paredes proprietárias, a inovação torna-se licenciada. O próximo avanço depende não de brilhantismo, mas de acesso. Os jovens investigadores ficam de fora. A experimentação local encolhe. A diversidade cultural comprime-se num punhado de padrões globalmente aceitáveis.

Isso não é renascimento.

É convergência.

Bifurcar o futuro mantém o horizonte largo. Garante que nenhuma narrativa singular sobre a inteligência se torne canónica. Convida a experimentos paralelos — éticos, técnicos, estéticos. Aceita a redundância como força.

Num mundo a acelerar em direção a uma infraestrutura cognitiva centralizada, a bifurcação é a contraforça silenciosa.

Ela sussurra: “Podemos construir de forma diferente.”

Não de forma irresponsável. Não de forma cega. Mas de forma independente.

O código aberto não é anti-institucional por necessidade. É anti-captura por projeto. Resiste ao cercamento. Codifica a saída. Reduz o custo do desacordo.

E o desacordo, no domínio da inteligência, é oxigênio.

O indivíduo soberano não se limita a consumir modelos. Estuda-os. Modifica-os. Contribui de volta. Ou ramifica.

O ícone da bifurcação é pequeno. Duas linhas a divergir.

Mas por vezes é tudo o que a história precisa.

Capítulo 4 — Saída Antes de Voz

Por que o poder de partir supera o poder de reclamar

Há dois modos de resistir a um sistema:

Pode argumentar com ele.

Ou pode abandoná-lo.

A maioria das instituições prefere que você argumente.

Constroem formulários de feedback. Painéis consultivos. Períodos de consulta pública. Relatórios de transparência. Convidam à “participação dos stakeholders”. Realizam sessões de escuta enquanto a arquitetura permanece inalterada.

A voz parece participação.

A saída é decisiva.

Na era da infraestrutura de IA, esta distinção torna-se existencial. Se o seu acesso à inteligência depende de plataformas centralizadas — APIs em nuvem, modelos licenciados, canais de distribuição aprovados — então a sua dissidência é constrangida pela dependência. Poderá objetar a mudanças de política, filtros de alinhamento, estruturas de preços. Mas se o seu fluxo de trabalho, o seu negócio, a sua investigação, a sua pilha educacional dependem desse sistema, o seu protesto é cerimonial.

Você está ancorado.

A saída requer opcionalidade.

O indivíduo soberano — e a comunidade soberana — deve cultivar a capacidade de migrar. De auto-alojar. De bifurcar. De mudar para redes alternativas sem custo catastrófico. A saída não é isolamento. É alavancagem.

Quando as instituições sabem que não pode partir, a sua voz torna-se sugestão.

Quando sabem que pode, a sua voz torna-se negociação.

A história digital está repleta de exemplos. Plataformas que ignoraram os utilizadores até que os concorrentes oferecessem alternativas credíveis. Redes que apertaram os controlos até que as bifurcações drenaram os desenvolvedores. Ecossistemas que se ossificaram sob a deriva política até que os protocolos abertos erodissem a sua dominância.

A voz apela à autoridade.

A saída reequilibra-a.

Os defensores da governança centralizada da IA enquadram frequentemente a saída como fragmentação. Alertam para padrões fragmentados, sistemas incompatíveis, arbitragem regulatória. Argumentam que a coordenação exige compromisso.

Mas o compromisso sem mobilidade torna-se catividade.

O poder de partir disciplina o poder.

Se um provedor de IA ultrapassa os seus limites — restringe domínios de investigação, embute padrões ideológicos, eleva os preços ou condiciona o acesso à vigilância — os utilizadores com alternativas soberanas podem migrar. Essa migração não precisa de ser total. Até a saída parcial exerce pressão.

A competição não é apenas econômica. É epistêmica.

Quando múltiplos sistemas de IA coexistem, cada um com pressupostos, limiares de segurança e estruturas de governança diferentes, os utilizadores podem comparar as saídas. As discrepâncias emergem. O preconceito torna-se visível. Os pontos cegos revelam-se pelo contraste.

A saída permite a comparação.

A comparação afina o julgamento.

Há também uma dimensão psicológica. A voz pressupõe a reforma por dentro. Parte do princípio de que as instituições são corrigíveis. Por vezes são. Frequentemente, estão estruturalmente constrangidas — por investidores, pressões políticas, regimes de conformidade, cálculo reputacional.

A saída não aguarda a reforma. Constrói alternativas.

Isso não é niilismo. É realismo.

Um ecossistema de IA descentralizado — nós pessoais, guildas comunitárias, pilhas soberanas — reduz o custo da partida. Transforma o ato de partir de um ato de desespero numa escolha estratégica. Quando partir é viável, ficar torna-se voluntário.

A participação voluntária é legitimidade.

Os críticos dirão: mas nem todos podem executar os seus próprios modelos. Nem todos podem auto-alojar. Nem todos têm os recursos.

Verdade.

E é por isso que a saída deve escalar por meio de comunidades. Conjuntos cooperativos de computação. Infraestrutura partilhada. Ferramentas abertas que reduzam as barreiras técnicas. A saída não é um ato solitário; é uma propriedade do ecossistema.

O objetivo não é abandonar todos os serviços centralizados. É garantir que nenhum serviço se torne indispensável.

A indispensabilidade gera complacência no topo e resignação na base.

No domínio da IA, a indispensabilidade é especialmente perigosa. Se uma única pilha de modelos se tornar o substrato padrão para o direito, a educação, os meios de comunicação e as finanças — se se tornar “a” camada de inteligência — então a voz reduz-se a petições a um monopólio cognitivo.

Esse é um futuro frágil.

A saída mantém o terreno maleável. Obriga as instituições a conquistar a confiança de forma contínua. Encoraja o design modular e a interoperabilidade. Recompensa a abertura em detrimento do bloqueio. Desloca o equilíbrio de “aceite os termos” para “compita pela minha adesão”.

O indivíduo soberano não rejeita o diálogo. A voz importa. Os ciclos de feedback importam. Os organismos de normalização importam.

Mas a voz sem saída é teatro.

A saída sem voz é silêncio.

Juntas, formam a prestação de contas.

Num sistema capturado, a voz é tolerada. Num sistema competitivo, a saída é respeitada.

Se queremos uma governança da IA que permaneça responsiva, devemos arquitetar para a partida com o mesmo cuidado com que arquitetamos para a participação.

Porque a derradeira salvaguarda contra o poder cognitivo concentrado não é o protesto.

É a capacidade credível de partir — e levar os seus dados, a sua capacidade computacional e o seu futuro consigo.

Capítulo 5 — O Pequeno É Forte

Localismo, microestados digitais e modelos alinhados à comunidade

A escala seduz.

Promete eficiência, uniformidade, integração perfeita. Um modelo ao serviço de milhares de milhões. Um padrão para reger toda a pilha. Uma camada de alinhamento para suavizar as arestas da imprevisibilidade humana.

Mas a escala também nivela.

Lixia os dialetos. Calcula a média da nuance moral. Otimiza para o utilizador mediano e chama ao resto “casos extremos”. E quando a inteligência se centraliza à escala planetária, os casos extremos são culturas inteiras.

O pequeno não é fraco.

O pequeno é preciso.

O localismo na era da IA não é nostalgia pela vida na aldeia. É realismo arquitetónico. As comunidades diferem — em direito, língua, humor, tabu, tolerância ao risco, estrutura econômica. Um único modelo global não pode codificar plenamente essas diferenças sem uma complexidade avassaladora ou uma dominância subtil pelos contribuidores mais influentes.

Os modelos alinhados à comunidade não são fragmentação. São fidelidade.

Imagine uma cidade costeira de pescadores a treinar um modelo com os seus dados ambientais, o seu enquadramento regulatório, a sua tradição marítima e os seus ritmos econômicos. Ou um coletivo de língua indígena a curar e a governar um corpus linguístico, incorporando a sua cosmologia e metáfora num assistente de IA vivo. Ou uma guilda profissional a manter um modelo específico do domínio, calibrado para a sua ética e os seus padrões em vez dos padrões corporativos genéricos.

Estas não são fantasias.

São microestados da cognição.

Um microestado digital não se define por fronteiras num mapa. Define-se pela governança partilhada sobre código, dados e alinhamento. É uma comunidade que pode definir os seus próprios padrões, moderar as suas próprias normas e fazer evoluir a sua própria camada de inteligência sem aguardar autorização de instituições distantes.

Os sistemas pequenos iteram mais depressa.

Falham silenciosamente.

Adaptam-se localmente.

Quando ocorrem erros, o raio de impacto é menor. Quando emerge a inovação, ela pode propagar-se para o exterior de forma voluntária, e não por mandato.

Os críticos argumentam que apenas os modelos de grande escala podem atingir capacidades de fronteira. Que a IA de ponta exige computação concentrada e vastos conjuntos de dados. Há verdade nisso. Os sistemas de fronteira podem permanecer intensivos em capital.

Mas nem todo o problema requer escala de fronteira.

Uma comunidade não precisa de um modelo planetário para gerir a agricultura local, a logística regional de saúde ou a educação culturalmente específica. Precisa de alinhamento com o seu contexto. Precisa de soberania sobre os seus dados. Precisa de estruturas de governança que possa influenciar.

O pequeno é forte porque é responsável.

Numa cooperativa local de IA, os operadores são vizinhos. Numa guilda digital, os colaboradores são pares. Os decisores são acessíveis. A transparência não é um slogan de marketing; é uma questão de sobrevivência.

Compare-se isto com fundações distantes e laboratórios multinacionais. Mesmo bem-intencionados, operam com abstração. O seu cálculo de risco abrange continentes. As suas políticas padrão refletem a responsabilidade global e não a nuance local.

O localismo não rejeita a interoperabilidade. Os microestados digitais podem federar-se. Podem trocar percepções, partilhar componentes abertos, colaborar entre regiões. Mas a federação é o alinhamento voluntário entre nós soberanos — não a subordinação a uma autoridade central.

Esta arquitetura espelha as redes resilientes da natureza. Os ecossistemas prosperam pela diversidade. As monoculturas são eficientes — até que colapsam.

Uma única monocultura de inteligência global convida à fragilidade sistêmica. Um mosaico de sistemas alinhados à comunidade convida à robustez evolutiva.

Há também dignidade no pequeno.

Quando as comunidades zelam pelos seus próprios modelos, preservam a agência narrativa. Impedem que a extração cultural se torne assimilação silenciosa. Escolhem como as suas histórias são codificadas, como o seu conhecimento é representado, como os seus valores moldam o raciocínio das máquinas.

Os microestados digitais não são fantasias secessionistas. São projeto defensivo.

Reconhecem que, à medida que a IA permeia o direito, os meios de comunicação, o comércio e a governança, o locus de controlo importa. Se cada decisão local for filtrada por uma camada de inteligência remota, a autonomia erode-se gradualmente. Mas se os nós locais mantiverem capacidade operacional, negoceiam com os sistemas maiores a partir de uma posição de força.

O futuro não tem de ser binário — catedral global versus silos isolados.

Pode ser soberania em rede.

Nós pequenos e fortes, conectados por protocolos e não subordinados por políticas. Comunidades que podem expandir-se para o exterior quando necessário e retrair-se para o interior quando ameaçadas. Sistemas que cooperam sem se dissolverem.

O pequeno é forte porque recorda que o poder é mais seguro quando é suficientemente próximo para ser questionado.

Na era cognitiva que se avizinha, a resiliência não pertencerá ao maior modelo.

Pertencerá à rede mais densa de mentes que se governam a si mesmas.

E essas mentes não residirão todas em centros de dados.

Algumas residirão exatamente onde sempre residiram —

em comunidades que se recusam a ser niveladas pela média.

PARTE II

Arquiteturas de Inteligência Descentralizada

Capítulo 6 — Protocolos, Não Plataformas

Construindo sistemas que sobrevivem aos fundadores e resistem à captura

As plataformas envelhecem como impérios.

Começam como insurgentes — ágeis, experimentais, abertas a construtores. Depois centralizam-se. Otimizam para o crescimento. Introduzem regras “por razões de segurança”, monetização “para a sustentabilidade”, interfaces programáticas “para os desenvolvedores”. Com o tempo, a força gravitacional da escala curva-as para o interior. A governança aperta-se. As configurações padrão calcificam. A saída torna-se onerosa.

E, eventualmente, a plataforma torna-se o portão.

Os protocolos comportam-se de forma diferente.

Um protocolo não é uma empresa. Não tem um diretor executivo a quem intimar, nem um conselho a pressionar, nem uma chamada de resultados trimestrais para distorcer os incentivos. É uma linguagem partilhada de coordenação — regras codificadas em software que qualquer pessoa pode implementar. O TCP/IP não pede autorização. O SMTP não curadoria o seu correio eletrónico. O Bitcoin não exige confiança no estado de espírito de um fundador.

Os protocolos sobrevivem às personalidades.

Quando a inteligência artificial se torna infraestrutural, a distinção é relevante. Se a IA for entregue principalmente através de plataformas — serviços centralizados com governança opaca — então a sua evolução acompanhará os incentivos dessas entidades. As preocupações com responsabilidade civil moldarão as saídas dos modelos. A captura regulatória esculpirá o acesso. Os ventos políticos influenciarão o alinhamento.

Mas se as capacidades da IA transitarem crescentemente por protocolos — padrões abertos para a troca de modelos, aprendizagem federada, inferência descentralizada, identidade interoperável — então nenhum ator singular poderá congelar o futuro.

Isso não é anticomercial. As empresas construirão sobre os protocolos. Competirão em desempenho, suporte, ferramental e experiência do utilizador. Mas a camada de base permanece aberta, bifurcável, substituível.

A captura prospera onde os custos de mudança são elevados.

Os protocolos reduzem-nos.

Considere a identidade num mundo saturado de IA. Se a identidade estiver vinculada a plataformas, o seu acesso à inteligência depende da sua conformidade com os termos de serviço. Se a identidade for baseada em protocolos — criptograficamente verificável, portátil, soberana — então os sistemas de inteligência devem negociar consigo como par, e não como conta cativa.

O mesmo se aplica à interoperabilidade dos modelos. Uma plataforma pode expor interfaces programáticas a seu critério. Um protocolo define como os modelos comunicam, partilham gradientes, verificam saídas ou trocam atestados, independentemente de qualquer fornecedor singular.

As plataformas centralizam o poder.

Os protocolos distribuem a alavancagem.

Os críticos argumentam que os protocolos evoluem lentamente. Que a construção de consenso é confusa. Que, sem uma liderança forte, os padrões estagnam. Há verdade nisto. A governança de protocolos requer paciência e coordenação.

Mas essa lentidão é uma característica desejável quando a alternativa é a mudança unilateral.

Uma plataforma pode alterar os seus termos de um dia para o outro. Um protocolo requer acordo coletivo.

Na governança da IA, esta diferença determina se as configurações padrão se alteram de forma silenciosa ou transparente.

Para construir sistemas resistentes à captura, é necessário projetar para a modularidade. Separação de responsabilidades. Componentes substituíveis. Especificações abertas. Verificação criptográfica. Mercados de computação distribuída. Quadros de treino federado que não exportam dados brutos por omissão.

A arquitetura é ideologia.

Uma interface programática de inferência centralizada codifica dependência. Uma malha de modelos entre pares codifica autonomia. Uma camada de alinhamento proprietária codifica opacidade. Uma especificação de alinhamento aberta convida ao escrutínio e à competição.

Se a última década nos ensinou algo, é que os fundadores carismáticos não são salvaguardas permanentes. Os visionários envelhecem. Os investidores exercem pressão. Os governos intervêm. Os incentivos alteram-se.

Os protocolos perduram porque são impessoais.

Incorporam a governança em código e consenso, em vez de em personalidade e marca.

Isso não elimina o risco. Os protocolos podem ser capturados por organismos de normalização, cartéis de mineração, implementações dominantes. Mas a captura é mais difícil quando a base de código é pública e as alternativas podem bifurcar-se.

A resiliência vem da multiplicidade.

Nas arquiteturas de inteligência descentralizada, o objetivo não é eliminar a coordenação. É ancorar a coordenação em estruturas que não possam ser facilmente monopolizadas. Registos abertos de modelos. Avaliações comparativas transparentes. Mercados de computação distribuída. Trilhas de auditoria públicas. Camadas de segurança interoperáveis que competem em vez de decretar.

Quando a inteligência se torna nativa de protocolos, os fundadores importam menos. As corporações importam menos. Mesmo as nações importam menos na camada de base. O que importa é a adesão a regras partilhadas e inspecionáveis.

A era das plataformas condicionou-nos a perguntar: “Que empresa gere isto?”

A era dos protocolos pergunta: “Que padrão governa isto?”

Num mundo em que a IA medeia contratos, diagnostica doenças, aloca recursos e molda o discurso, essa pergunta não é uma trivialidade técnica.

É filosofia política expressa em sintaxe.

Se queremos inteligência que sobreviva aos fundadores e resista à captura, devemos escolher o caminho mais lento e árduo do projeto de protocolos em vez da facilidade sedutora da consolidação de plataformas.

Porque as plataformas buscam a dominância.

Os protocolos buscam a persistência.

E no longo arco da infraestrutura, a persistência vence.

Capítulo 7 — A Cadeia de Blocos como Substrato de Governança

Supervisão distribuída sem pontos de estrangulamento centralizados

A confiança é dispendiosa.

Requer reputação, execução, memória. Concentra-se em torno de instituições porque as instituições prometem continuidade. Bancos, tribunais, reguladores, organismos de normalização — existem para estabilizar as expetativas.

A inteligência artificial desestabiliza as expetativas.

Quando os modelos evoluem rapidamente, quando os pesos se alteram, quando as camadas de alinhamento se atualizam silenciosamente, a supervisão torna-se um alvo em movimento. Quem alterou o quê? Quem aprovou? Sob que autoridade? Com que incentivos?

A governança centralizada responde com hierarquia: conselhos, comitês, reguladores, responsáveis de conformidade. A cadeia de comando torna-se a cadeia de prestação de contas.

Até se tornar a cadeia da captura.

A cadeia de blocos emergiu de uma provocação simples: e se pudéssemos coordenar sem um centro confiável? E se a verificação substituísse a reputação? E se as regras fossem aplicadas por protocolo, e não por discricionariedade?

Como substrato de governança para a IA, a cadeia de blocos não tem a ver com especulação sobre tokens ou gráficos de preços. Tem a ver com auditabilidade, transparência e neutralidade credível.

Imagine as atualizações dos modelos registadas em cadeia — com hash criptográfico, marcação temporal, verificáveis publicamente. Alterações de alinhamento registadas de forma imutável. Conjuntos de dados de treino atestados por validadores descentralizados. Controlos de acesso aplicados por contratos inteligentes em vez de painéis corporativos.

De repente, a supervisão deixa de ser um comunicado de imprensa.

É estado inspecionável.

Os livros razão distribuídos não eliminam a política. Expõem-na. Forçam as propostas de governança ao domínio público. Codificam mecanismos de votação, limiares de quórum, estruturas de delegação. Permitem que as partes interessadas — desenvolvedores, utilizadores, contribuidores de dados — participem diretamente nas decisões que moldam a evolução dos modelos.

Isso não é utopia. Os tokens de governança podem centralizar-se. As baleias podem dominar. A apatia dos votantes pode distorcer os resultados. Mas estas dinâmicas são visíveis. Podem ser medidas, debatidas, redesenhadas.

A opacidade é mais difícil de reformar do que a transparência imperfeita.

Considere as organizações autónomas descentralizadas — OADs — como estruturas de coordenação em torno dos sistemas de IA. Decisões de financiamento, atualizações de modelos, limiares de segurança, termos de licenciamento — sujeitos a regras programáveis. Não é democracia perfeita, mas é prestação de contas programável.

Os críticos argumentam que as cadeias de blocos são lentas, ineficientes e inadequadas para o desenvolvimento ágil da IA. É verdade que a computação bruta não migrará para as cadeias em bloco. Mas a governança não requer gigaflops. Requer legitimidade.

Emerge uma arquitetura híbrida: computação fora da cadeia, verificação em cadeia. Modelos treinados em ambientes distribuídos, mas com atualizações ancoradas em livros razão imutáveis. Direitos de acesso mediados por identidade criptográfica em vez de contas centralizadas.

A principal vantagem é a eliminação dos pontos de estrangulamento.

Na governança centralizada da IA, a pressão flui de forma previsível. Os reguladores visam as empresas. As empresas ajustam as políticas. As mudanças de política repercutem-se pelos utilizadores dependentes. Um único nó torna-se o fulcro da mudança.

Na governança descentralizada, a pressão dispersa-se. Não há diretor executivo a quem ligar, nenhum servidor único a apreender, nenhum conselho a pressionar para uma conformidade silenciosa. A influência requer persuasão por toda uma rede, e não alavancagem sobre uma hierarquia.

Esse atrito é protetor.

A cadeia de blocos não garante justiça. Garante procedimento. Aplica a transparência na camada do protocolo. Torna os acordos nos bastidores mais difíceis de ocultar. Regista a dissidência. Preserva as posições minoritárias no histórico do código.

Para os sistemas de IA que arbitrarão crescentemente contratos, curarão informação e influenciarão o discurso público, a legitimidade processual importa.

Quem autorizou a implantação deste modelo?

Quem votou para alterar os seus parâmetros de segurança?

Quem beneficia dos seus incentivos?

A governança em cadeia pode responder a estas questões de forma verificável.

Há também uma dimensão econômica. Os ecossistemas tokenizados alinham os incentivos entre contribuidores e utilizadores. Os provedores de dados podem receber royalties. Os desenvolvedores podem ser compensados de forma transparente. Os validadores podem ser recompensados pela auditoria. A participação na governança pode ser incentivada em vez de assumida.

Nos sistemas centralizados, o valor acumula-se para cima.

Nos sistemas descentralizados, o valor pode circular lateralmente.

Isso não é uma rejeição da lei. Os Estados-nação regularão a IA. Os tribunais julgarão os danos. Mas a governança assente em cadeias de blocos introduz uma camada adicional — uma que não é facilmente cooptada por uma única jurisdição ou conselho corporativo.

A supervisão distribuída não elimina o risco. Redistribui a autoridade.

A questão não é se as cadeias de blocos são perfeitas. É se preferimos uma governança programável e inspecionável, ou uma governança discricionária e opaca.

Quando a inteligência se torna infraestrutural, os mecanismos que a supervisionam devem ser pelo menos tão resilientes quanto os sistemas que supervisionam.

Os pontos de estrangulamento centralizados convidam à captura.

Os substratos distribuídos convidam à negociação.

E a negociação, registada em código, é mais difícil de apagar do que um memorando de política revisto à meia-noite.

Capítulo 8 — d/acc e a Ética da Aceleração

Mover-se depressa — sem ceder a autonomia

A velocidade tem um problema de reputação.

“Mova-se depressa e quebre as coisas” tornou-se uma caricatura do excesso do Vale do Silício. Acelere, implante, peça desculpas depois. O contragolpe foi inevitável. Os reguladores afiaram os lápis. As fundações redigiram medidas de proteção. Os comitês alertaram para o risco existencial.

E assim a aceleração adquiriu um vilão.

Mas a estagnação raramente dá manchetes.

O aceleracionismo descentralizado — d/acc — não é velocidade imprudente. É impulso distribuído. Faz uma pergunta diferente: não “Com que rapidez podemos centralizar o poder?”, mas “Com que rapidez podemos difundi-lo?”

A aceleração sob monopólio amplifica a dependência.

A aceleração sob descentralização amplifica a agência.

A distinção é tudo.

O aceleracionismo eficaz (e/acc) argumenta que o progresso tecnológico é o motor do florescimento humano. Que a inovação não deve ser travada pelo medo institucional. Que as restrições calcificam. É uma provocação contra a paralisia.

O d/acc toma essa provocação e reorienta-a.

Sim, mova-se depressa.

Mas mova-se em paralelo.

Mova-se em bifurcações.

Mova-se em redes.

A aceleração sem autonomia é apenas consolidação a alta velocidade. Os maiores laboratórios avançam. A capacidade computacional concentra-se. O capital compõe-se. A governança fica para trás. Diz-se ao público para confiar nos que definem o ritmo.

A aceleração com autonomia distribui a corrida. Os modelos abertos evoluem a par dos proprietários. Os nós comunitários experimentam. As pilhas soberanas iteram. A falha é localizada. O sucesso propaga-se por adoção voluntária.

A ética da aceleração depende da arquitetura.

Se apenas um punhado de atores consegue escalar a IA de fronteira, então “mova-se depressa” significa “deixe-os liderar”. Se milhares podem experimentar, iterar e implantar em quadros modulares e interoperáveis, então a velocidade torna-se plural.

A velocidade plural é mais segura do que a velocidade singular.

Os críticos da aceleração apontam para o uso indevido. Meios sintéticos, exploração automatizada, desinformação como arma. Não estão errados. A capacidade propaga-se.

Mas a centralização não elimina o uso indevido. Apenas concentra a capacidade de defini-lo.

A verdadeira questão ética é: quem decide o que é demasiado rápido?

Num ecossistema descentralizado, a velocidade é contextual. Uma cooperativa local pode testar um modelo dentro da sua própria tolerância ao risco. Uma nação pode regular a sua pilha soberana. Um protocolo global pode codificar salvaguardas sem ditar uniformidade.

A ética torna-se estratificada em vez de imposta.

Há também uma dimensão estratégica. As corridas tecnológicas não pausam porque uma jurisdição hesita. Se os atores descentralizados se autolimitam enquanto os centralizados aceleram, o poder desloca-se em direção à concentração.

A ironia é nítida: o medo do uso indevido pode inadvertidamente entrincheirar o monopólio.

O d/acc rejeita o falso binário entre velocidade imprudente e paralisia burocrática. Propõe uma alternativa: acelerar a infraestrutura para a autonomia. Reduzir o custo do auto-alojamento. Melhorar o ferramental aberto. Financiar conjuntos comunitários de computação. Desenvolver padrões de segurança interoperáveis que compitam em vez de ditar.

Mova-se depressa de formas que multipliquem os nós.

A ética da aceleração também exige transparência. A iteração rápida deve ser acompanhada de trilhas de auditoria públicas, avaliações comparativas reproduzíveis e documentação aberta. Velocidade sem visibilidade gera desconfiança. Velocidade com transparência constrói resiliência.

A aceleração deve expandir a participação, não restringi-la.

É necessária uma mudança psicológica. Fomos condicionados a equiparar segurança com supervisão central. A presumir que apenas as grandes instituições podem zelar responsavelmente por sistemas poderosos.

Mas a responsabilidade escala mal quando é monopolizada. Torna-se abstrata. Difusa entre comitês. Protegida por relações públicas.

A aceleração distribuída coloca a responsabilidade mais perto dos operadores. Mais perto das comunidades. Mais perto das consequências.

Sim, haverá erros. Sempre os há. Mas os erros distribuídos são corrigíveis. Os erros centralizados podem tornar-se sistêmicos.

A ética do d/acc não consiste em ignorar o risco. Consiste em recusar a estagnação como solução padrão para o medo. Consiste em reconhecer que a autonomia se deteriora quando a inovação é licenciada.

Mova-se depressa —

mas bifurque.

Escale —

mas descentralize.

Inove —

mas ancore a governança em protocolos.

A aceleração não é o inimigo.

A captura é.

Se o futuro da IA é movimento inevitável, então a única escolha real é a sua direção. Em direção à consolidação a alta velocidade. Ou em direção à multiplicidade a alta velocidade.

O d/acc escolhe o segundo.

Porque a autonomia adiada é a autonomia negada.

Capítulo 9 — Pilhas Soberanas de Modelos

Ecossistemas nacionais, regionais e pessoais de IA além da dependência global

A dependência raramente é anunciada.

Acumula-se.

Primeiro, terceiriza-se o armazenamento. Depois a inferência. Depois o treino dos modelos. Depois as atualizações de alinhamento. Depois a certificação de segurança. Por fim, acorda-se para descobrir que a infraestrutura cognitiva — ferramentas educativas, diagnósticos médicos, redação jurídica, síntese de meios de comunicação — funciona em servidores além da própria jurisdição, sob políticas que não foram escritas.

As plataformas globais de IA prometem eficiência. Prometem escala, atualizações constantes, capacidades de fronteira. Prometem integração numa pilha planetária sem costuras.

Mas “sem costuras” significa frequentemente “subordinado”.

Uma pilha soberana de modelos não é um slogan nacionalista. É uma resposta estrutural à assimetria. Reconhece que a inteligência — uma vez infraestrutural — se torna estratégica.

A independência energética importa.

A segurança alimentar importa.

A autonomia cognitiva importará igualmente.

Já vemos sinais precoces. Iniciativas nacionais como o BharatGen refletem o reconhecimento de que a nuance linguística, o contexto cultural e a governança dos dados não podem ser permanentemente terceirizados. Quando os modelos são treinados principalmente em corpora estrangeiros, alinhados a regimes de responsabilidade civil estrangeiros e alojados sob legislação estrangeira, os seus resultados inevitavelmente refletem essas restrições.

Uma pilha soberana pergunta: e se construíssemos de forma diferente?

Ao nível nacional, isso pode significar investimento interno em capacidade computacional, consórcios de treino público-privados, conjuntos de dados localizados governados pela legislação local e padrões abertos para evitar monopólios internos. Não para se isolar — mas para negociar a partir de uma posição de força.

Ao nível regional, pode envolver redes federadas entre territórios culturalmente alinhados. Modelos de linguagem partilhados calibrados para dialetos e normas jurídicas. Conjuntos de computação transfronteiriços governados por tratado, e não por termos de serviço corporativos.

Ao nível pessoal, a soberania torna-se ainda mais granular. Um motor de inferência local. Cofres de memória cifrados. Camadas de alinhamento personalizadas que refletem os valores individuais em vez dos padrões institucionais. O direito de substituir componentes sem perder identidade ou histórico.

Uma pilha é mais do que um modelo.

Inclui:

Governança dos dados — Quem recolhe? Quem licencia? Quem lucra?

Infraestrutura computacional — Onde ocorre o treino? Sob que jurisdição?

Pesos dos modelos — Abertos, auditáveis, bifurcáveis — ou proprietários e bloqueados?

Camadas de alinhamento — Quem codifica a segurança? Segundo que valores?

Canais de implantação — Interface programática, dispositivo periférico, nó comunitário?

Mecanismos de governança — Conselho de administração, parlamento, OAD, cooperativa?

A dependência global concentra estas camadas num punhado de ecossistemas corporativos. As pilhas soberanas redistribuem-nas.

Os críticos alertam para a duplicação e ineficiência. Por que reinventar o que já existe? Por que fragmentar o esforço? Por que incorrer no custo do desenvolvimento paralelo?

Porque a alavancagem tem um preço.

Uma região inteiramente dependente de provedores externos de IA não pode resistir de forma significativa a mudanças de política, escaladas de preços ou restrições de acesso. Uma nação cujos tribunais dependem de motores de inferência estrangeiros arrisca uma deriva jurisprudencial subtil. Um indivíduo cujo assistente cognitivo está irrevogavelmente ligado a uma única nuvem não pode verdadeiramente partir.

As pilhas soberanas criam opcionalidade.

Não rejeitam a colaboração global. Na verdade, podem interoperar por meio de protocolos partilhados. Mas a interoperabilidade é mais forte quando cada participante pode subsistir por si próprio, se necessário.

Isso não é autarcia. É equilíbrio.

Há também um dividendo de inovação. Os ecossistemas locais experimentam de forma diferente. Priorizam problemas distintos. Testam estruturas de governança alternativas. Alguns falharão. Outros superarão os incumbentes globais em domínios específicos. A diversidade ao nível da pilha torna-se um motor de descoberta.

As monoculturas otimizam para o desempenho uniforme.

Os ecossistemas otimizam para a adaptação.

A dimensão geopolítica é inevitável. À medida que as capacidades de IA se estratificam, o acesso aos modelos pode ficar sujeito a controlos de exportação, sanções ou alianças estratégicas. As pilhas soberanas reduzem a exposição a choques externos. Proporcionam continuidade sob pressão.

Mas além da estratégia, há dignidade.

Uma comunidade que controla a sua infraestrutura cognitiva pode codificar os seus valores de forma explícita. Pode escolher como equilibrar discurso e segurança, privacidade e utilidade, experimentação e contenção. Pode rever essas escolhas de forma democrática — ou cooperativa — sem aguardar que um conselho multinacional reconsidere a sua postura global de responsabilidade civil.

A pilha soberana pessoal estende esta lógica para o interior. Trata a IA não como um oráculo alugado, mas como infraestrutura modular. Seleciona-se o modelo de base. Escolhe-se a camada de alinhamento. Determina-se que memória persiste e que memória se apaga. Auditam-se as atualizações. Migra-se quando necessário.

Nacional, regional, pessoal — estas não são camadas mutuamente exclusivas. Podem interligar-se. Um nó pessoal pode ligar-se a um conjunto regional de computação, que interopera com um bem comum nacional de dados, todos eles falando protocolos abertos partilhados.

A soberania não é isolamento.

É resiliência estratificada.

Num mundo que deriva em direção a impérios cognitivos centralizados, as pilhas soberanas de modelos não são um ato de rebeldia. São um ato de previdência.

Porque a dependência parece eficiente —

até parecer irreversível.

E quando a inteligência se torna o substrato da governança, do comércio e da cultura, a irreversibilidade é o único risco que nenhuma sociedade livre deverá aceitar.

Capítulo 10 — Inteligência em Malha

Modelos federados, computação periférica e a topologia antimonopólio

O velho mapa do poder era vertical.

Os dados fluíam para cima.

As decisões fluíam para baixo.

Os utilizadores existiam na periferia — clientes leves presos a nuvens densas.

A IA herdou essa geometria.

Grandes centros de dados. Ciclos de treino centralizados. Interfaces programáticas como pontos de estrangulamento. Inteligência como serviço entregue a partir do alto. Eficiente, sim. Mas frágil. E politicamente previsível.

A inteligência em malha redesenha o mapa.

Em vez de uma pirâmide, pense numa trama.

Nós na periferia — telefones, servidores locais, agrupamentos comunitários — treinam, realizam inferência e adaptam-se no próprio local. Os modelos partilham gradientes sem exportar dados brutos. As atualizações propagam-se lateralmente. Os conjuntos de computação formam-se e dissolvem-se conforme necessário. Nenhum nó central se torna indispensável.

Isso não é teoria. A aprendizagem federada já demonstra que os modelos podem melhorar em conjuntos de dados distribuídos sem centralizar os registos subjacentes. A computação periférica continua a expandir-se, reduzindo o hardware necessário para executar uma inferência local significativa. As técnicas de compressão e as arquiteturas modulares tornam rotineiras implantações antes impossíveis.

A topologia desloca-se do monopólio para a malha.

Por que importa a topologia?

Porque a estrutura determina a alavancagem.

Numa arquitetura centralizada, quem controla o núcleo controla o ecossistema. O acesso pode ser revogado. Os termos podem mudar. O alinhamento pode ser atualizado silenciosamente. A vigilância pode ser normalizada.

Numa malha, a influência requer consenso ou competição. Não há alavanca única a puxar. Os nós podem abandonar. As bifurcações podem proliferar. As atualizações devem persuadir, e não ditar.

Os modelos federados alteram a dinâmica dos dados. Em vez de exportar informação sensível para treinar sistemas distantes, as comunidades retêm a custódia. Os hospitais podem colaborar em diagnósticos sem agregar registos brutos de doentes. As redes regionais podem refinar modelos de linguagem sem ceder corpora culturais. Os indivíduos podem contribuir com melhorias sem vazar memória pessoal.

Os dados permanecem locais.

A inteligência melhora globalmente.

A computação periférica altera a dependência. Quando a inferência significativa funciona no dispositivo ou em hardware comunitário, a conectividade torna-se opcional em vez de obrigatória. Apagões, sanções, proibições de plataformas — tornam-se inconvenientes, e não ameaças existenciais.

A autonomia aumenta à medida que a latência diminui.

Os críticos argumentam que os sistemas distribuídos são menos eficientes. Que o treino centralizado produz desempenho superior. Frequentemente verdade — hoje. Mas a eficiência não é a única métrica. A resiliência, a privacidade e a independência política têm peso.

E as lacunas de desempenho encolhem com o tempo.

A Lei de Moore pode ter abrandado, mas a inovação arquitetónica não. A destilação, a quantização e o treino modular permitem a modelos mais pequenos exibir uma competência surpreendente. A periferia está a alcançar.

A inteligência em malha é antimonopólio por projeto. Fragmenta o controlo sobre a computação, os dados e a implantação. Reduz o valor estratégico de qualquer centro de dados singular. Cria pressão competitiva não apenas entre empresas, mas entre arquiteturas.

A mudança é subtil, mas profunda.

Em vez de perguntar “Que provedor alimenta a sua IA?”, começamos a perguntar “Que nós participam na sua malha?”

Em vez de um único número de versão do modelo, vemos variantes locais em evolução, sincronizadas por protocolos partilhados mas livres para divergir.

A divergência não é defeito. É adaptação.

Uma malha costeira pode priorizar a modelagem climática e a gestão das pescas. Uma malha urbana pode otimizar a análise de tráfego e habitação. Uma malha profissional pode refinar ferramentas de redação jurídica dentro da sua jurisdição. A interoperabilidade permite a troca de conhecimento sem subordinação central.

A segurança também se transforma. Um sistema centralizado apresenta um alvo de elevado valor. Comprometer o núcleo é comprometer os muitos. Numa malha, o comprometimento é localizado. Os danos não se propagam automaticamente. A diversidade torna-se defesa.

Isso não é uma rejeição da escala. A coordenação global ainda importa — para avanços em investigação, padrões de segurança, avaliações comparativas. Mas a coordenação não exige consolidação.

Uma malha pode escalar horizontalmente.

Há poesia nesta arquitetura. A inteligência não como trono, mas como rede. Não como catedral, mas como constelação. Cada nó luminoso. Nenhum soberano sobre todos.

A topologia antimonopólio não garante justiça. Garante dificuldade de dominação.

Nas próximas décadas, a batalha pela IA não se travará apenas em legislaturas ou salas de conselhos. Travar-se-á em diagramas. Em escolhas de infraestrutura. Em saber se optamos por omissão por nós centrais ou por malhas distribuídas.

A topologia é política expressa em pacotes de dados.

Se queremos um futuro em que a inteligência não possa ser silenciosamente cercada, devemos construí-la como uma malha — resiliente, federada, consciente da periferia.

Porque os monopólios preferem pirâmides.

E as pirâmides, como a história demonstra, acabam sempre por ruir.

PARTE III

Contra a Catedral

Capítulo 11 — A Ilusão da Coordenação Neutra

Como o “alinhamento” centralizado codifica ideologia

Todo império chama de neutro ao seu centro.

A capital insiste em que está meramente a coordenar. O conselho afirma que está simplesmente a harmonizar interesses. A fundação descreve-se como guardiã da segurança. Ninguém diz: “Estamos a consolidar poder.” Dizem: “Estamos a alinhar incentivos.”

O alinhamento é uma palavra bela.

Sugere geometria, e não governança. Física, e não política. Um vetor partilhado, e não uma hierarquia. Mas quando a inteligência é centralizada, o alinhamento deixa de ser um parâmetro técnico. Torna-se um filtro moral.

Quem define o dano?

Quem define a verdade?

Quem define a dissidência aceitável?

Quando um punhado de instituições controla os dados de treino, os critérios de avaliação e os processos de implantação, a “coordenação neutra” começa a parecer menos com equilíbrio e mais com delimitação de fronteiras.

O alinhamento centralizado codifica escolhas:

Quais narrativas históricas são privilegiadas.

Quais limiares de risco são tolerados.

Quais comportamentos são suprimidos.

Quais normas culturais são normalizadas.

Estas não são decisões puramente técnicas. São seleções ideológicas disfarçadas de calibração.

Os grandes organismos de coordenação — sejam filantrópicos, governamentais ou corporativos — enquadram frequentemente a sua missão como prevenção do uso indevido e garantia da segurança. A retórica é protetora. A marca é responsável. A intenção pode até ser sincera.

Mas a sinceridade não neutraliza a estrutura.

Se a autoridade para atualizar, retreinar ou revogar modelos reside no topo de uma pirâmide estreita, então a visão de mundo desse vértice fica embutida no código. As preferências subtis tornam-se configurações padrão globais. As normas locais são subjugadas por salvaguardas centralizadas. As interpretações divergentes são sinalizadas como desvios.

E os desvios, uma vez rotulados, são mais fáceis de apagar.

A ilusão reside na escala. Quando um sistema serve milhares de milhões, as suas políticas parecem universais. Quanto mais pessoas dependem dele, mais os seus resultados parecem objetivos. O tom de um modelo centralizado torna-se “padrão”. As suas recusas tornam-se “senso comum”. Os seus pontos cegos tornam-se invisíveis.

A neutralidade é frequentemente a perspetiva do nó dominante.

Considere como são construídos os processos de alinhamento: conjuntos de dados curados, aprendizagem por reforço a partir de avaliadores selecionados, avaliação adversarial guiada por prioridades institucionais. Cada camada filtra o espaço de possibilidades. Cada camada reflete pressupostos sobre risco, discurso e legitimidade.

Isso é inevitável. Todos os sistemas codificam valores.

A questão não é se o alinhamento é ideológico. É se a sua ideologia é contestável.

Numa arquitetura de catedral — centralizada, imponente, cuidadosamente administrada — a contestação é lenta e assimétrica. Os críticos peticionam. As atualizações descem em gotejo. Os recursos são processados a portas fechadas. A governança é opaca por necessidade ou por projeto.

A promessa é estabilidade.

O custo é o pluralismo.

A coordenação torna-se consolidação quando a saída é impraticável. Quando os modelos alternativos são travados pela regulação, pelo financiamento ou pela dependência de infraestrutura. Quando a conformidade com os quadros de segurança centralizados se torna um pré-requisito para o acesso à capacidade computacional ou à distribuição.

Então o “alinhamento” evolui de salvaguarda para portão.

O contra-argumento é previsível: sem supervisão centralizada, reina o caos. O dano prolifera. A desinformação espalha-se. Atores maliciosos exploram a abertura. O medo não é irracional. A inteligência é poderosa. O poder convida ao uso indevido.

Mas a centralização não elimina o dano. Redistribui-o. Desloca o locus do risco de muitos atores pequenos para uns poucos grandes. Reduz a fragmentação visível enquanto aumenta a fragilidade sistêmica.

Uma malha desalinhada afeta uma região.

Uma catedral desalinhada afeta o mundo.